【入門】機械学習とディープラーニング違いは?特徴やニューラルネットワークについても解説

本ページにはプロモーションが

含まれていることがあります

「機械学習」や「ディープラーニング」はデータサイエンスではよく聞く用語で、近年は社会的にも注目を浴びている分野です。

本記事ではこれらに関して説明し、それぞれの関係性が理解できるよう解説します。

AI・データサイエンス、機械学習の

実践力を高めたい方へ

- プログラミングを0から学びたい

- データサイエンティスト、データアナリストを目指したい

- AIエンジニア、大規模言語モデル(LLM)エンジニアを目指したい

AI人材コースを

無料体験してみませんか?

無料で120以上の教材を学び放題!

理解度を記録して進捗管理できる!

テキストの重要箇所にハイライトを残せる!

割引クーポンやsale情報が届く!

1分で簡単!無料!

▶無料体験して特典を受け取る

40時間以上の動画講座が見放題!

追加購入不要!これだけで学習できるカリキュラム

(質問制度や添削プラン等)充実したサポート体制!

▶AI人材コースを見る

目次

機械学習とディープラーニングの違い

まずは、機械学習とディープラーニングの違い、関係を整理しておきましょう。

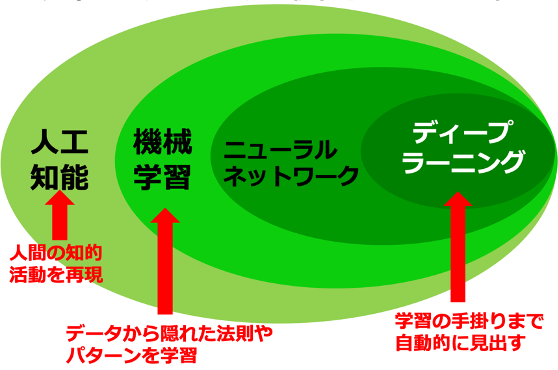

AI(人工知能)、機械学習、ニューラルネットワーク、ディープラーニングは上記の図のような関係にあります。

いずれも人工知能という広い概念に包含される手法で、ディープラーニングは機械学習をさらに技術的に進めた手法をいいます。

つまりディープラーニングは機械学習の一種です。

機械学習とディープラーニングはどっちから学ぶ?

結論から言うと、まずは機械学習から学ぶのがおすすめです。

機械学習の基礎がディープラーニングにも必要だから

上記でも図でも解説しましたが、ディープラーニング(深層学習)は機械学習の一種であり、基礎的な考え方は機械学習と共通しています。

例えば、

- データの前処理(特徴量エンジニアリング、正規化など)

- 評価指標(精度、適合率・再現率、RMSEなど)

- 過学習対策(正則化、交差検証など)

これらの知識はディープラーニングを理解する上でも不可欠です。

ディープラーニングは計算コストが高く、環境構築も大変だから

ディープラーニングは、大量のデータと高性能なGPUが必要になることが多いです。

一方、機械学習はPC1台で手軽に試せるため、学習のハードルが低くなります。

数学の難易度が異なるから

機械学習は「線形回帰」「決定木」「ランダムフォレスト」など比較的シンプルなアルゴリズムが中心ですが、ディープラーニングでは微分・行列計算・確率統計などの高度な数学が必要になります。

機械学習を先に学んでおくと、ディープラーニングの理解がスムーズになります。

機械学習ではデータを与えなければならない

機械学習は、一般的なコンピュータプログラムに比べると自律性が高く、データを与えることで自ら法則やパターンを見出せます。

常に一定の処理しかできないのではなく、学習を経て、状況に応じた最適な答えを導き出せるのです。

ただ、がむしゃらに多くのデータを与えても適切な学習は行われません。

予測の手掛かりとして使える、特微量の準備が重要です。

生のデータをただ放り込むだけで高精度なモデルは得られないため、人間がある程度手助けをしてあげなくてはなりません。

例えば以下のような加工を要します。

- 外れ値や欠損値の削除

- データの補填・補正

- データの結合・分割・集計

- 文字列データのダミー数値化

そのため、作業者に負担がかかってしまいます。

自動翻訳や音声認識など、実用化も進む技術ではありますが、課題も多く残る手法なのです。

ディープラーニングではデータも自ら抽出

続いてディープラーニングを見ていきましょう。

こちらは機械学習よりさらに高い自律性を有する手法をいいます。

従来の課題を解決するため、そしてより自動化された意思決定を行うために活用されます。

最も大きな違いは、特微量をデータから自ら抽出できる点にあります。

より人間の思考に近づいているといえるでしょう。

データの加工を行う手間が、他の手法に比べると少なくて済みます。

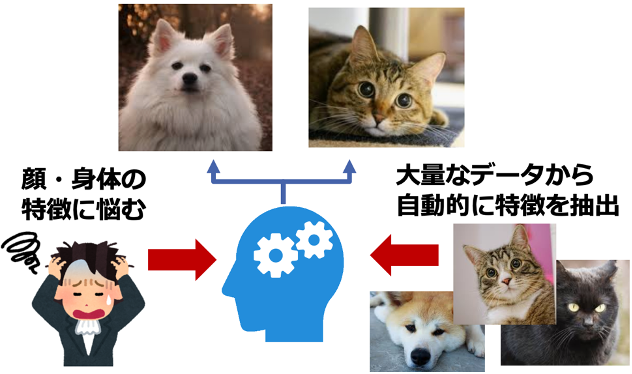

具体的なイメージを掴むため、図2を用います。

図2が表すのは、犬と猫を画像から区別するというタスクです。

機械学習だと、画像の特徴を数値で表し、学習データとして準備しなければなりません。

輪郭や明暗、耳の形、ひげの角度などといった特徴を人間が細かく設定しなければならず、作業量が多い上に、小さな領域に着目すると人間でも判別が難しいという問題に直面します。

これに対しディープラーニングであれば、犬/猫のラベル付けを行った画像を多数用意し、モデルにフィードするだけで足ります。

すべて自ら認識、整理してくれ、法則やパターンを見出してくれます。

実はこの技術は近年登場したわけではなく、何十年も前から研究されていました。

しかしインターネットの普及に伴いデータの収集が容易になったこと、デバイスの処理性能が向上したことなどが後押しとなり、一気に実用化が加速したのです。

ニューラルネットワークにより実現

上の仕組みを実現するには「ニューラルネットワーク」というアルゴリズムが使われます。

これは人間の脳内にある神経回路を数式的なモデルで表現したものです。

要は深い層からなるネットワーク構造で、データに対し多数の組み合わせパターンで学習を進めるものを言います。

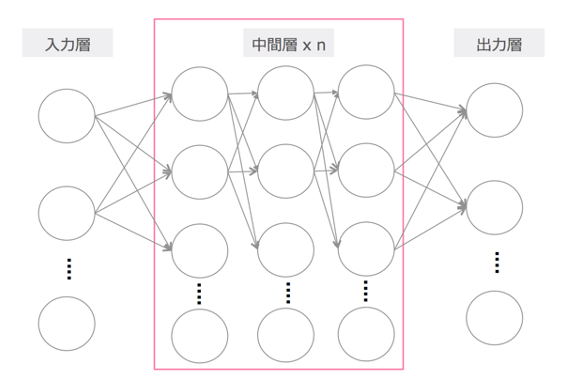

下の概念図を見てみましょう(図3)。

「入力層」と「中間層」、「出力層」の3つの層があることが分かります。

入力層と出力層はその名の通り、それぞれデータを受け取る層と予測結果を出力する層のことです。

これらの層に挟まれた中間層は、答えを導くために、入力データから特徴量を少しずつ導出する役割を果たします。

図3では、深く構成された層が多数の経路で繋がれており、データの様々な組み合わせを重ねることで正解を導く、ということが表されています。

この分野は非常に奥が深いですし、今後も伸びていく分野とも考えられています。

本記事では簡単に説明しましたが、興味のある方はより深く学習し、様々な領域で応用すると良いでしょう。

関連記事:E資格とは?合格率(合格点)・難易度や本当に「意味がない」のかも解説

AI・データサイエンス、機械学習の

実践力を高めたい方へ

- プログラミングを0から学びたい

- データサイエンティスト、データアナリストを目指したい

- AIエンジニア、大規模言語モデル(LLM)エンジニアを目指したい

AI人材コースを

無料体験してみませんか?

無料で120以上の教材を学び放題!

理解度を記録して進捗管理できる!

テキストの重要箇所にハイライトを残せる!

割引クーポンやsale情報が届く!

1分で簡単!無料!

▶無料体験して特典を受け取る

40時間以上の動画講座が見放題!

追加購入不要!これだけで学習できるカリキュラム

(質問制度や添削プラン等)充実したサポート体制!

会員20万人突破記念!

全商品5%OFF!